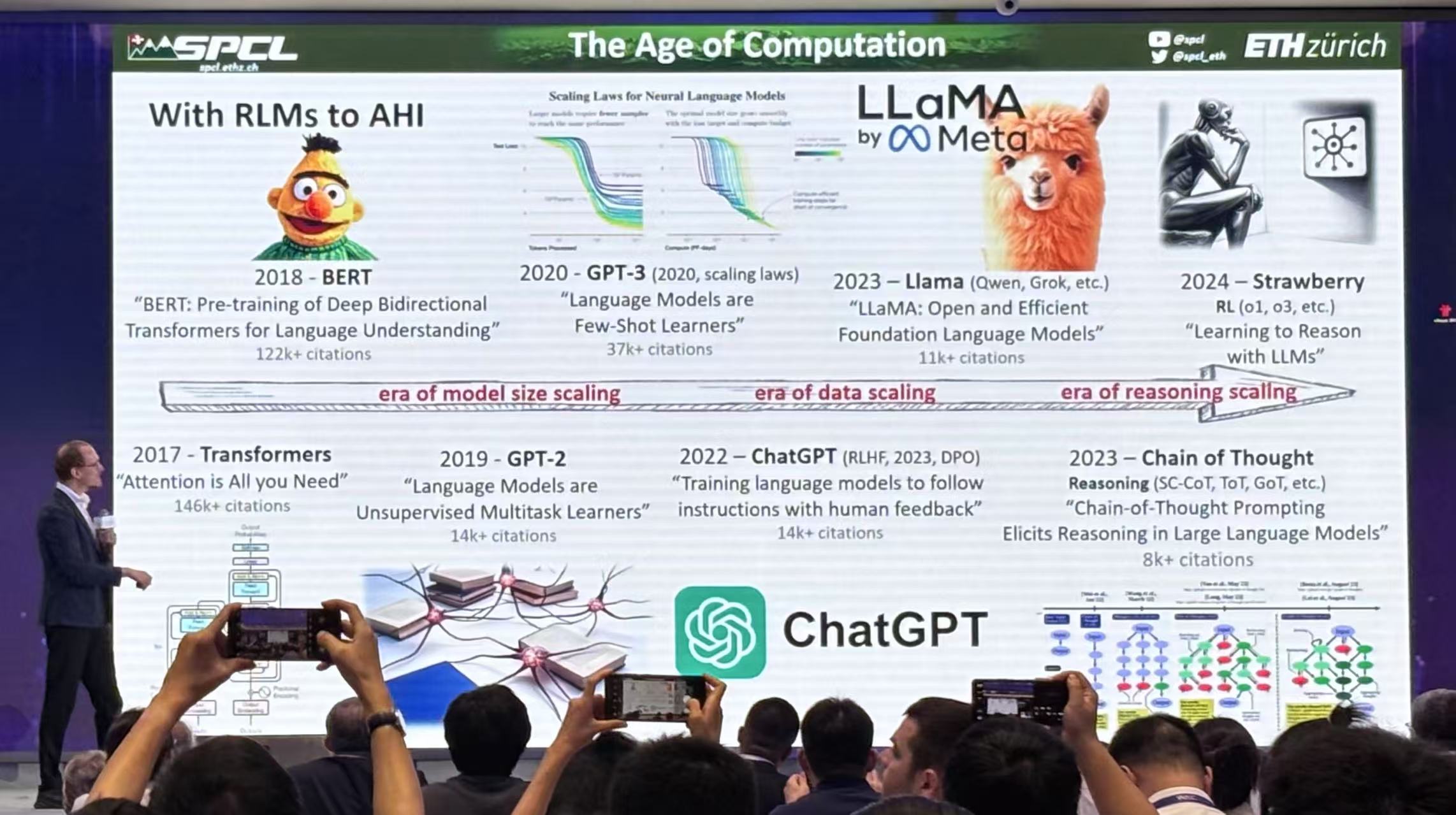

From Large Language Models to Reasoning Language Models - 计算时代的3个发展阶段

From Large Language Models to Reasoning Language Models - Three Eras in The Age of Computation.

Era of model size scaling 模型规模扩展的时代

2017 - Transformers “Attention is All you Need”

- 核心思想与贡献

目标:用纯注意力机制(无需RNN/CNN)解决序列建模问题,实现并行化训练并捕获长距离依赖。

关键创新:

**自注意力(Self-Attention)**:动态计算序列中所有位置间的关联权重。

**多头注意力(Multi-Head Attention)**:并行学习不同子空间的注意力模式。

**位置编码(Positional Encoding)**:注入序列顺序信息,替代RNN的时序性。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 提拉的Studio!